Ollama 是一个基于 Go 语言开发的简单易用的本地大语言模型运行框架。在管理模型的同时,它还基于 Go 语言中的 Web 框架 gin提供了一些 Api 接口,让你能够像跟 OpenAI 提供的接口那样进行交互。

Ollama 官方还提供了跟 docker hub 一样的模型 hub,用于存放各种大语言模型,开发者也可以上传自己训练好的模型供其他人使用。

安装 ollama

可以在 ollama 的 github release 页面直接下载对应平台的二进制包进行安装,也可以 docker 一键部署。这里演示的机器是 macOS M1 PRO 版本,直接下载安装包,安装即可,安装之后,运行软件。

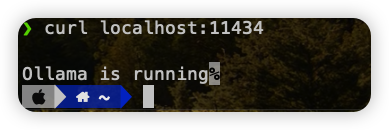

运行之后,项目默认监听 11434 端口,在终端执行如下命令可验证是否正常运行:

1 | curl localhost:11434 |

大模型管理

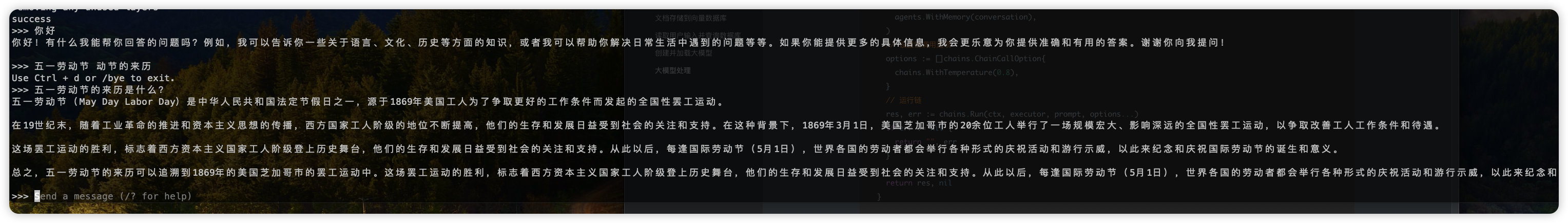

ollama 安装后,就可以对大模型进项安装使用了。Ollama 还会携带一个命令行工具,通过它可以与模型进行交互。

ollama list:显示模型列表。ollama show:显示模型的信息ollama pull:拉取模型ollama push:推送模型ollama cp:拷贝一个模型ollama rm:删除一个模型ollama run:运行一个模型

在官方提供的模型仓库中可以找到你想要的模型:https://ollama.com/library

注意:应该至少有 8 GB 可用 RAM 来运行 7 B 型号,16 GB 来运行 13 B 型号,32 GB 来运行 33 B 型号。

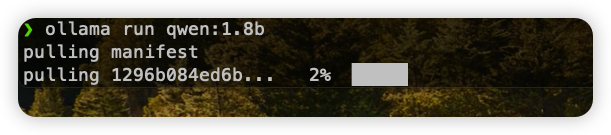

比如我们可以选择 Qwen 做个演示,这里用 1.8B 的模型(本地电脑比较可怜,只有 16G😭):

1 | ollama run qwen:1.8b |

是不是觉得这个命令似曾相识,是的,跟 docker run image 一样,如果本地没有该模型,则会先下载模型再运行。

既然跟 docker 如此一致,那么是不是也会有跟 Dockerfile 一样的东西,是的,叫做 Modelfile :

1 | FROM qwen:14b |

保存上面的代码为 Modelfile,运行 llama create choose-a-model-name -f Modelfile 就可以定制你的模型,ollama run choose-a-model-name 就可以使用刚刚定制的模型。

对接 ollama 实现本地知识库问答系统

前置准备

模型都在本地安装好了,我们可以对接这个模型,开发一些好玩的上层 AI 应用。下面我们基于 langchaningo 开发一个问答系统。

下面的系统会用到的模型有 ollama qwen1.8B,nomic-embed-text,先来安装这两个模型:

1 | ollama run qwen:1.8b |

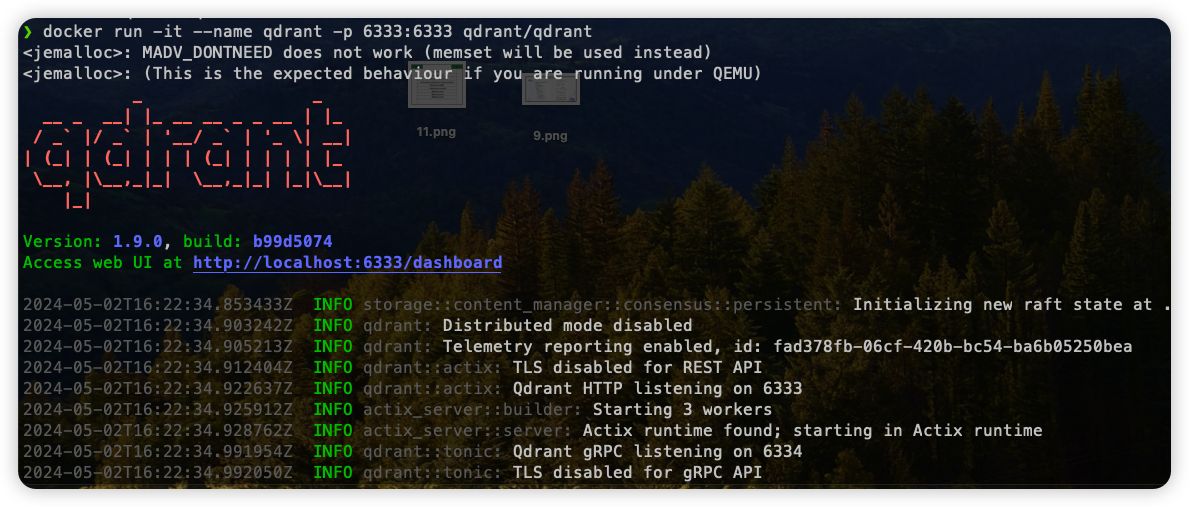

我们还需要一个向量数据库来存储拆分后的知识库内容,这里我们使用 qdrant :

1 | docker pull qdrant/qdrant |

启动 qdrant 后我们先创建一个 Collection 用于存储文档拆分块:

1 | curl -X PUT http://localhost:6333/collections/langchaingo-ollama-rag \ |

知识库内容切分

这里提供一篇文章供大模型学习,下面的代码将文章拆分成小的文档块:

1 | func TextToChunks(dirFile string, chunkSize, chunkOverlap int) ([]schema.Document, error) { |

文档存储到向量数据库

1 | func storeDocs(docs []schema.Document, store *qdrant.Store) error { |

读取用户输入并查询数据库

1 | func useRetriaver(store *qdrant.Store, prompt string, topk int) ([]schema.Document, error) { |

创建并加载大模型

1 | func getOllamaQwen() *ollama.LLM { |

大模型处理

将检索到的内容,交给大语言模型处理

1 | // GetAnswer 获取答案 |

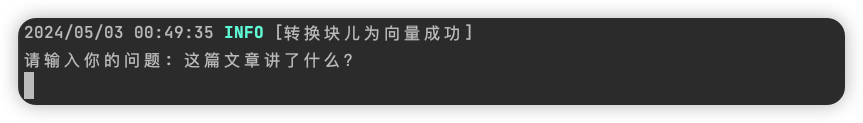

运行应用

1 | go run main.go getanswer |

输入你想要咨询的问题

系统输出结果:

输出的结果可能会因为学习资料的不足或者模型的大小存在区别,有很多结果都不是很准确,这就需要提供更多的语料进行训练。而且还要对代码里的各个参数进行调优,并结合文档的内容,大小,格式等进行参数的设定。

项目的源码可以参考:https://github.com/hantmac/langchaingo-ollama-rag.git